# 神经网络训练算法

本文介绍 ROM Builder 工具箱中使用的神经网络训练算法及其原理。

# 1. 静态模型与动态模型

目前工具箱关于静态模型与动态模型的区分原则为输入输出的映射关系:

- 若每个时刻输出仅与当前时刻输入有关,则为静态模型,训练算法可选择前馈神经网络模型或响应面,映射关系可表达为:

- 若每个时刻输出不仅与当前时刻输入有关,还与上一时刻状态相关,则为动态模型,训练算法可选择长短时记忆神经网络模型或响应面,映射关系可表达为:

# 1.1 静态类模型

- 前馈神经网络

- 残差前馈神经网络

- 注意力前馈神经网络

- 响应面模型

# 1.2 动态类模型

- 长短时记忆神经网络

- 残差长短时记忆神经网络

- 注意力长短时记忆神经网络

- 响应面模型

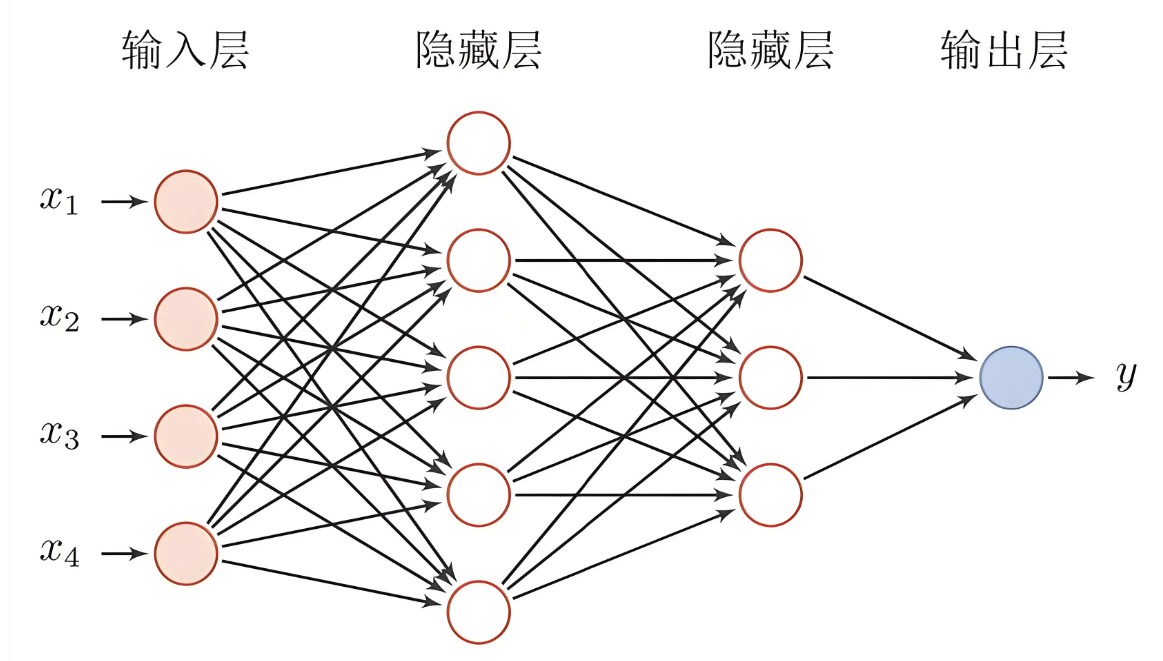

# 2. 前馈神经网络

前馈神经网络,是人工神经网络的一种,采用一种单向多层结构。其中每一层包含若干个神经元。在此种神经网络中,各神经元可以接收前一层神经元的信号,并产生输出到下一层。第 0 层叫输入层,最后一层叫输出层,其他中间层叫做隐藏层。隐藏层可以是一层,也可以是多层。

前馈神经网络的训练过程就是通过不断地进行前向传播和反向传播来优化网络参数,使得网络能够学习到输入与输出之间的映射关系,从而实现对未知数据的预测。

前向传播

每个神经元以上一层的各个节点作为输入,通过线性变换(结合偏置)和非线性函数激活,得到该节点的输出,并传递给下一层节点。

反向传播

使用神经网络对数据进行建模,最终目标为找到最合适的参数(权重和偏置),对数据进行最佳逼近。神经网络可以视作为一个非常复杂的复合函数,使用链式法则进行求导,形成梯度反向传播。

# 3. 残差前馈神经网络

残差前馈神经网络是在前馈神经网络基础上引入“残差连接”的改进模型。其核心思想是在网络输出中直接融合原始输入信息,使模型在学习复杂映射关系的同时,保留输入的基础特征。

相较于前馈神经网络的改进点

- 引入残差连接,使信息可以跨层直接传递

- 增加非线性变换模块,提高特征表达能力

- 引入可学习的残差权重,增强模型自适应能力

- 在深层网络中有效缓解训练困难问题

与前馈神经网络的主要区别

- 前馈神经网络:逐层传递信息,容易出现信息衰减

- 残差前馈神经网络:允许输入信息“跳跃”传播,信息保留更充分

适用场景

- 深层前馈网络建模(如多层全连接网络)

- 输入特征较复杂、维度较高的任务

- 对训练稳定性要求较高的工程场景

- 回归问题或复杂非线性映射问题

# 4. 注意力前馈神经网络

注意力前馈神经网络在前馈神经网络基础上引入注意力机制,并结合残差结构,对不同特征赋予不同的重要性权重,从而提升模型对关键特征的识别能力。

相较于前馈神经网络的改进点

- 引入注意力机制,实现特征加权

- 自动突出重要特征,抑制无关信息

- 结合残差结构,提高信息融合能力

与前馈神经网络的主要区别

- 前馈神经网络:所有特征同等对待

- 注意力前馈神经网络:能够“选择性关注”重要特征

适用场景

- 特征重要性差异较大的数据(如工业数据、金融数据)

- 高维输入特征筛选问题

- 对模型解释性有一定要求的场景

- 分类任务(如状态识别、异常检测)

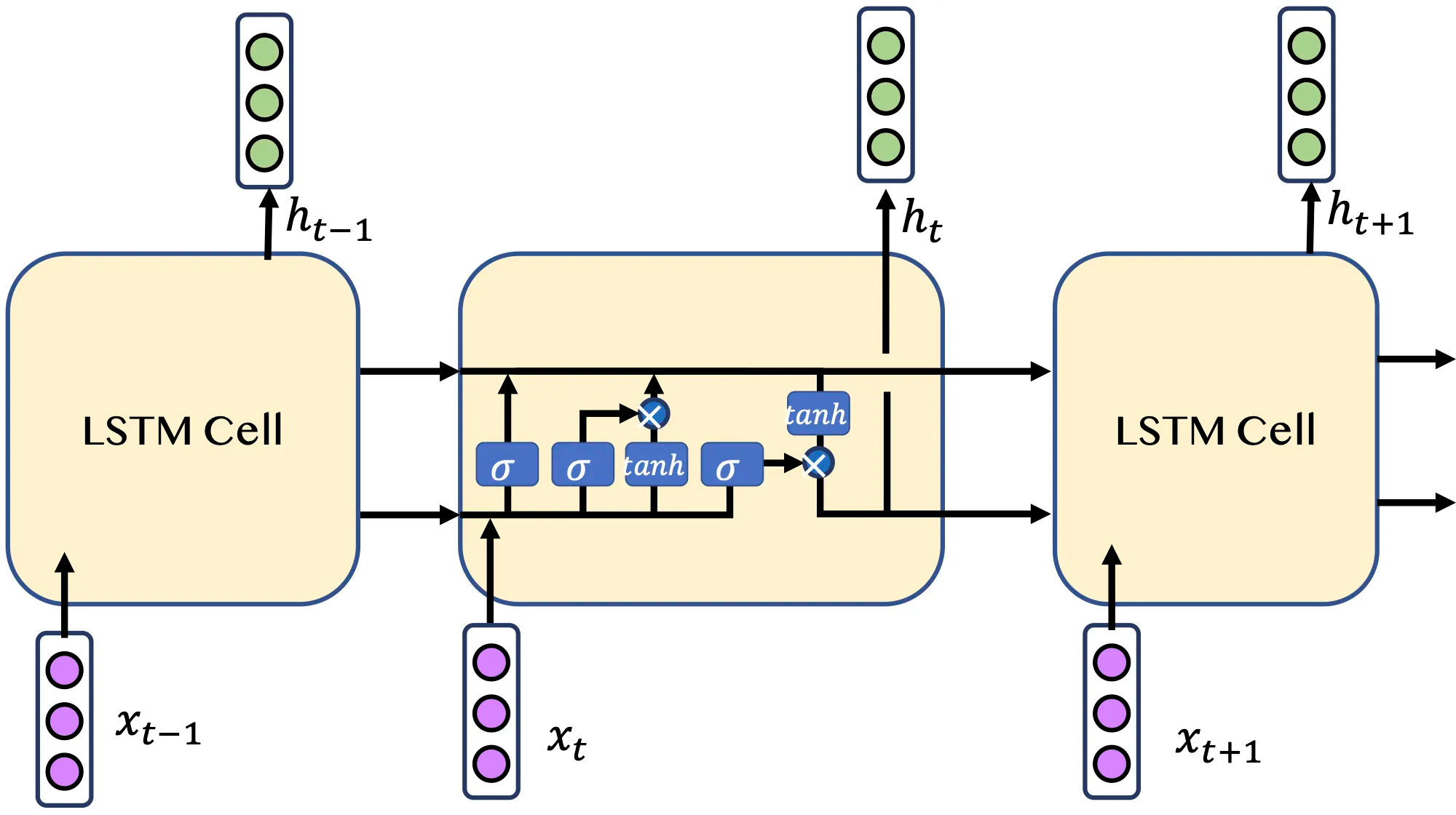

# 5. 长短时记忆神经网络

长短时记忆神经网络(LSTM)用于训练动态模型。长短时记忆神经网络(LSTM)与前馈神经网络相比,其独特之处在于引入了门控机制,包括遗忘门、输入门和输出门,以及细胞状态。这些门控机制允许 LSTM 网络在处理序列数据时控制信息的流动和记忆,从而更好地捕捉长期依赖关系。

细胞状态

不同时间步之间传递信息时,记住之前的信息并在后续时间步中使用这些信息。

门控机制

允许网络在处理信息时选择性地记住或忘记之前的信息,从而更好地适应序列数据的特点。

# 6. 残差长短时记忆神经网络

残差长短时记忆神经网络是在长短时记忆神经网络结构中引入残差连接,使每个时间步的输入信息能够直接参与输出计算,从而增强时序信息的表达能力。

相较于长短时记忆神经网络的改进点

- 引入残差连接,增强时间步之间的信息传递

- 增加非线性变换模块,提高表达能力

- 使用可学习权重控制残差贡献

与长短时记忆神经网络的主要区别

- 长短时记忆神经网络:依赖门控机制逐步传递信息

- 残差长短时记忆神经网络:增加“直接路径”,信息传递更加高效

适用场景

- 长序列建模(如时间序列预测)

- 需要提升训练稳定性的序列任务

- 数据存在短期与长期信息混合的情况

- 工业动态系统建模、设备预测

# 7. 注意力长短时记忆神经网络

注意力长短时记忆神经网络在长短时记忆神经网络基础上引入注意力机制,并通过局部与全局特征融合,提高模型对关键时间步信息的捕捉能力。

相较于长短时记忆神经网络的改进点

- 引入注意力机制,动态关注重要时间步

- 采用局部与全局两级 LSTM 结构

- 进行特征融合,提高序列建模能力

- 结合残差连接,增强信息保留

与长短时记忆神经网络的主要区别

- 长短时记忆神经网络:对所有时间步处理较为均衡

- 注意力长短时记忆神经网络:能够突出关键时间段信息

适用场景

- 序列中关键时间点明显的任务

- 复杂时序分析(如行为识别、故障检测)

- 长序列且信息分布不均的数据

- 多尺度时序建模问题

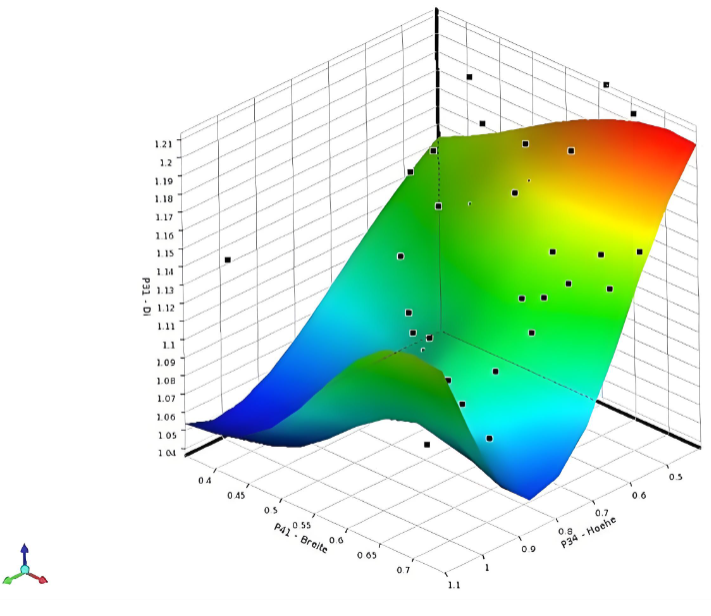

# 8. 响应面模型

响应面法(Response Surface Methodology, RSM)是一种基于多项式拟合的代理模型构建方法,核心是用低阶多项式函数近似替代复杂的真实物理或工程模型,实现快速预测和优化分析,适用于黑箱模型、高计算成本的场景,是工程优化中比较常用的代理模型之一。以二阶形式为例:

响应面方法不同阶数公式与最小样本数关系如下表所示:

| 阶次 | 初始化所需的最少样本点数 | 公式 |

|---|---|---|

| 1 阶 | ||

| 2 阶 | ||

| 3 阶 | ||

| ... | ... | ... ... |